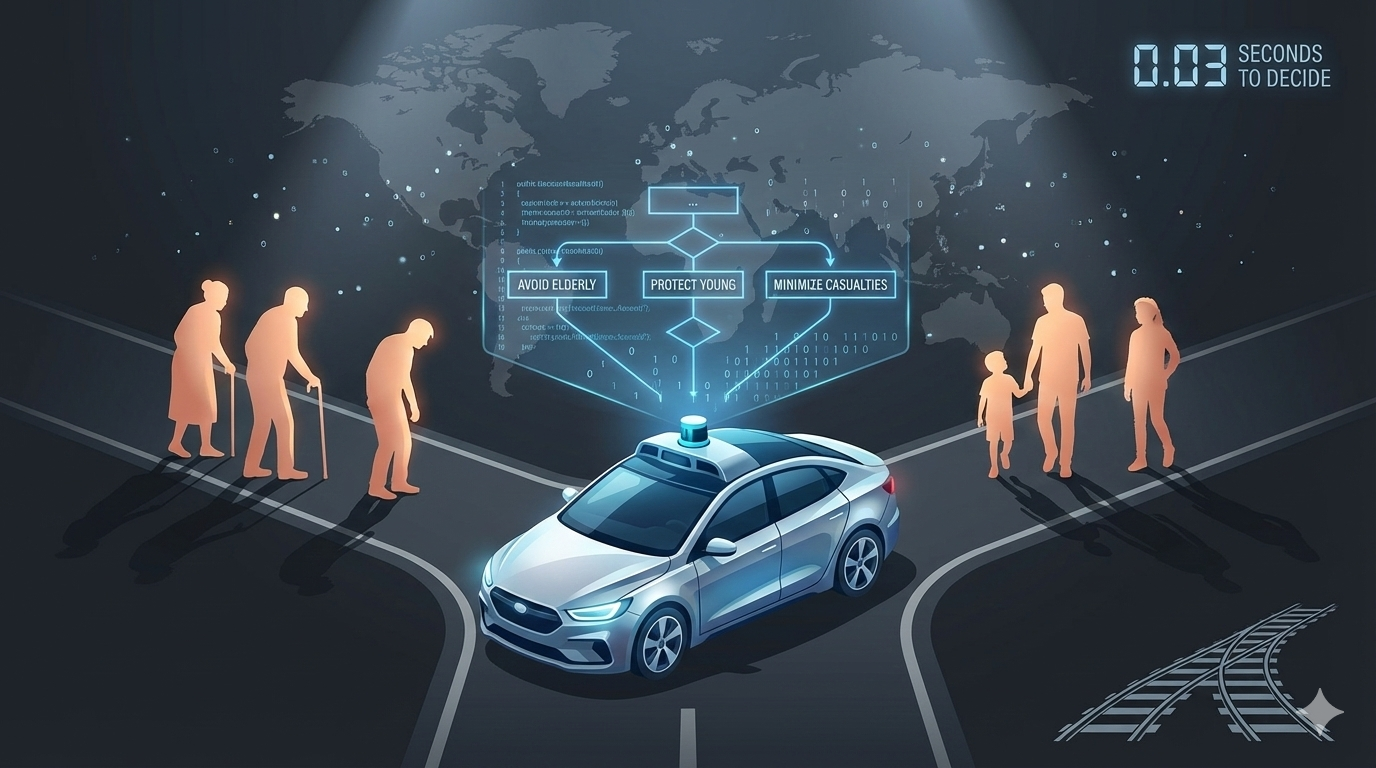

El carro autónomo detecta dos personas: una anciana y un niño. Los frenos fallan. Debe elegir. ¿A quién mata?

Tu respuesta depende de si naciste en Tokio, Buenos Aires o Helsinki. Y eso es exactamente lo que el experimento más grande sobre ética en inteligencia artificial demostró con 40 millones de decisiones.

El experimento

En 2016, investigadores del MIT Media Lab lanzaron “Moral Machine”: una plataforma online que presentaba dilemas morales que enfrentarían vehículos autónomos (Awad et al., 2018)[1]. Variaciones del clásico “Trolley Problem” aplicado a tecnología real.

¿Salvar dos pasajeros o cinco peatones? ¿Proteger a quien cruza legalmente o al jaywalker? ¿Priorizar niños sobre ancianos? ¿Humanos sobre animales? ¿Personas de alto estatus sobre personas sin hogar?

Los números: 40 millones de decisiones en 10 idiomas, 233 países. Publicado en Nature en 2018, es uno de los estudios de preferencias morales más grandes jamás realizados.

Lo que descubrieron (y por qué es inquietante)

Existen preferencias universales: todos prefieren salvar humanos sobre animales, más vidas sobre menos, jóvenes sobre ancianos.

Pero las diferencias culturales son enormes. Los investigadores identificaron tres “clusters” con preferencias marcadamente distintas (Awad et al., 2018)[1]:

Cluster Western (Norteamérica + Europa cristiana): Mayor preferencia por inacción del conductor, menor disposición a sacrificar pasajeros. Fuerte protección a quien respeta la ley.

Cluster Eastern (Asia + países islámicos): Menor énfasis en edad—posiblemente por mayor respeto a ancianos en culturas colectivistas. Mayor aceptación de decisión activa del vehículo.

Cluster Southern (LATAM + países en desarrollo): Mayor tolerancia con jaywalkers, probablemente debido a enforcement menos estricto de leyes.

El hallazgo más perturbador: En países con alta desigualdad económica, las personas mostraron mayor disposición a salvar individuos de alto estatus sobre bajo estatus (Awad et al., 2018)[1].

La desigualdad social se refleja directamente en las preferencias éticas que programaríamos en máquinas.

El problema que nadie quiere enfrentar

Si un Tesla diseñado en Silicon Valley prioriza la vida del conductor sobre peatones—reflejando preferencias Western—pero se vende en Ciudad de México, ¿de quién son los valores que estamos programando?

Edmond Awad, autor principal del estudio, fue explícito: “Parece preocupante que las personas encontraran aceptable en grado significativo priorizar alto estatus sobre bajo estatus. Es importante decir ‘Hey, podemos cuantificar eso’ en lugar de ‘Oh, tal vez deberíamos usar eso’” (Hao, 2018)[2].

Solo porque podemos medir una preferencia no significa que debamos codificarla.

Pero alguien tiene que programar estos vehículos. Y cuando lo hagan, elegirán un marco ético sobre otro. No existe la neutralidad.

La trampa del experimento

Moral Machine asume que debemos elegir a quién matar. Esa es una falsa premisa.

La pregunta correcta no es “¿a quién mata el carro?” sino “¿por qué construimos sistemas que nos fuerzan a elegir quién muere?”

Rahwan y colegas reconocieron esta limitación: en lugar de optimizar decisiones morales imposibles, deberíamos “emprender todos los esfuerzos razonables para reducir” los dilemas en primer lugar (Contissa et al., 2017)[3].

Pero esa conversación—sobre diseño urbano seguro, límites de velocidad, infraestructura peatonal—es menos sexy que debatir a quién debe matar un algoritmo. Y menos rentable para fabricantes de autos.

Tres verdades incómodas

1. No existe neutralidad ética en IA. Todo sistema refleja valores de quien lo construye. La pregunta es: ¿explícitos o implícitos?

2. Los valores no son universales. Lo aceptable en Japón no lo es en Brasil, y viceversa. Pretender “ética universal” es, en el mejor caso, ingenuo. En el peor, colonialismo algorítmico.

3. La tecnología del Norte Global se exporta al Sur con valores incluidos. Y casi nunca preguntamos si queremos esos valores.

¿Y entonces?

Moral Machine no resolvió el problema de programar ética en IA. Lo expuso.

Demostró que no hay solución técnica a un problema político: ¿quién decide qué valores programar en tecnología que afecta a todos?

Mientras Silicon Valley programa carros que reflejan sus preferencias, el resto del mundo hereda decisiones de vida o muerte diseñadas por y para otros.

La pregunta no es “¿puede la IA ser ética?”

Es “¿de quién es la ética que la IA ejecutará?”

Esa pregunta no tiene respuestas en papers académicos. Requiere política, democracia y—sobre todo—consentimiento.

Algo que, hasta ahora, nadie nos ha pedido.

Referencias:

[1] Awad, E., Dsouza, S., Kim, R., Schulz, J., Henrich, J., Shariff, A., Bonnefon, J.-F., & Rahwan, I. (2018). The Moral Machine experiment. Nature, 563(7729), 59-64. https://doi.org/10.1038/s41586-018-0637-6

[2] Hao, K. (2018, October 24). Should a self-driving car kill the baby or the grandma? Depends on where you’re from. MIT Technology Review. https://www.technologyreview.com/2018/10/24/139313/a-global-ethics-study-aims-to-help-ai-solve-the-self-driving-trolley-problem/

[3] Contissa, G., Lagioia, F., & Sartor, G. (2017). The ethical knob: ethically-customisable automated vehicles and the law. Artificial Intelligence and Law, 25(3), 365-378.

Recursos adicionales:

- Plataforma Moral Machine: http://moralmachine.mit.edu/

- Bonnefon, J.-F., Shariff, A., & Rahwan, I. (2016). The social dilemma of autonomous vehicles. Science, 352(6293), 1573-1576.

The autonomous car detects two people: an elderly woman and a child. The brakes fail. It must choose. Who does it kill?

Your answer depends on whether you were born in Tokyo, Buenos Aires, or Helsinki. And that’s exactly what the largest experiment on ethics in artificial intelligence demonstrated with 40 million decisions.

The experiment

In 2016, researchers at MIT Media Lab launched “Moral Machine”: an online platform presenting moral dilemmas that autonomous vehicles would face (Awad et al., 2018)[1]. Variations of the classic “Trolley Problem” applied to real technology.

Save two passengers or five pedestrians? Protect those crossing legally or jaywalkers? Prioritize children over the elderly? Humans over animals? High-status individuals over homeless people?

The numbers: 40 million decisions across 10 languages, 233 countries. Published in Nature in 2018, it’s one of the largest moral preference studies ever conducted.

What they discovered (and why it’s disturbing)

Universal preferences exist: everyone prefers saving humans over animals, more lives over fewer, young over old.

But cultural differences are enormous. Researchers identified three “clusters” with markedly distinct preferences (Awad et al., 2018)[1]:

Western Cluster (North America + Christian Europe): Greater preference for driver inaction, less willingness to sacrifice passengers. Strong protection for those who obey the law.

Eastern Cluster (Asia + Islamic countries): Less emphasis on age—possibly due to greater respect for elders in collectivist cultures. Greater acceptance of active vehicle decision-making.

Southern Cluster (Latin America + developing countries): Greater tolerance for jaywalkers, likely due to less strict law enforcement.

The most disturbing finding: In countries with high economic inequality, people showed greater willingness to save high-status individuals over low-status ones (Awad et al., 2018)[1].

Social inequality directly reflects in the ethical preferences we would program into machines.

The problem nobody wants to face

If a Tesla designed in Silicon Valley prioritizes the driver’s life over pedestrians—reflecting Western preferences—but sells in Mexico City, whose values are we programming?

Edmond Awad, the study’s lead author, was explicit: “It seems worrisome that people found it acceptable to a significant degree to prioritize high status over low status. It’s important to say ‘Hey, we can quantify this’ rather than ‘Oh, maybe we should use that’” (Hao, 2018)[2].

Just because we can measure a preference doesn’t mean we should codify it.

But someone has to program these vehicles. And when they do, they’ll choose one ethical framework over another. Neutrality doesn’t exist.

The experiment’s trap

Moral Machine assumes we must choose who to kill. That’s a false premise.

The correct question isn’t “who does the car kill?” but “why are we building systems that force us to choose who dies?”

Rahwan and colleagues acknowledged this limitation: instead of optimizing impossible moral decisions, we should “undertake all reasonable efforts to reduce” such dilemmas in the first place (Contissa et al., 2017)[3].

But that conversation—about safe urban design, speed limits, pedestrian infrastructure—is less sexy than debating who an algorithm should kill. And less profitable for car manufacturers.

Three uncomfortable truths

1. Ethical neutrality in AI doesn’t exist. Every system reflects its builder’s values. The question is: explicit or implicit?

2. Values aren’t universal. What’s acceptable in Japan isn’t in Brazil, and vice versa. Pretending “universal ethics” exists is, at best, naive. At worst, algorithmic colonialism.

3. Global North technology exports to the South with values included. And we almost never ask if we want those values.

So what now?

Moral Machine didn’t solve the problem of programming ethics into AI. It exposed it.

It demonstrated there’s no technical solution to a political problem: who decides what values to program into technology that affects everyone?

While Silicon Valley programs cars reflecting their preferences, the rest of the world inherits life-or-death decisions designed by and for others.

The question isn’t “can AI be ethical?”

It’s “whose ethics will the AI execute?”

That question has no answers in academic papers. It requires politics, democracy, and—above all—consent.

Something that, so far, nobody has asked for.

References:

[1] Awad, E., Dsouza, S., Kim, R., Schulz, J., Henrich, J., Shariff, A., Bonnefon, J.-F., & Rahwan, I. (2018). The Moral Machine experiment. Nature, 563(7729), 59-64. https://doi.org/10.1038/s41586-018-0637-6

[2] Hao, K. (2018, October 24). Should a self-driving car kill the baby or the grandma? Depends on where you’re from. MIT Technology Review. https://www.technologyreview.com/2018/10/24/139313/a-global-ethics-study-aims-to-help-ai-solve-the-self-driving-trolley-problem/

[3] Contissa, G., Lagioia, F., & Sartor, G. (2017). The ethical knob: ethically-customisable automated vehicles and the law. Artificial Intelligence and Law, 25(3), 365-378.

Additional resources:

- Moral Machine platform: http://moralmachine.mit.edu/

- Bonnefon, J.-F., Shariff, A., & Rahwan, I. (2016). The social dilemma of autonomous vehicles. Science, 352(6293), 1573-1576.